“Motion Brush” von Runway: Bilder gezielt über Markierungen animieren lassen

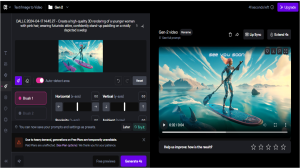

Aus einem PNG oder JPG (Bild) im Handumdrehen ein kurzes Video generieren und dabei ganz gezielt ausgewählte Passagen animieren lassen? Ja, dies geht mit KI-Anwendungen wie RunwayML und der Funktion “Motion Brush”. Hierbei markiert der User bestimmte Objekte, wählt etwa die Richtung aus (Vertikal/Horizontal) und drückt den “Generate-Button” zur Umsetzung.

Hier gibt es gleich einmal eine Zusammenfassung aller Schritte:

1) Bild über DALL-E3 oder weitere Bilder-KIs generieren

2) Bild-Upload auf Runwayml.com

3) Nutzen (bedingt kostenfrei) der Funktion “Motion Brush” in der linken Navigation. Markieren der Felder (Lila), die sich im Bild dann später im Video (MP4) bewegen sollen.

4) Button “Generate” klicken. Falls überladen (Free Version), dann mehrmals Button klicken.

Los geht es mit einem simplen Bild, ganz egal ob nun KI-generiert oder aus dem alten Fotoalbum. Das obere Exemplar wurde über DALL-E3 erstellt, aber natürlich geht dies auch über weitere Top-Bilder-KIs wie Midjourney oder die Open-Source-Variante Stable Diffusion. Auch innerhalb von Runway können Nutzer per Prompt Images erstellen. Wurde das Bild außerhalb von Runway generiert, dann ladet Ihr dieses als Asset auf Runwayml.com in Euren Bereich hoch. Wurde es hochgeladen, taucht es in der Kategorie “All Assets” auf. Nun sucht unten in der Liste Eurer Image und klickt rechts auf die drei Punkte und im Anschluss auf die Bezeichnung “Use Gen-2”

Danach in der linken Navigation auf “Motion Brush” und dann auf das Bild mit Doppelklick. Nun wurde es erfasst und kann im Rahmen der KI-Animation beliebig eingestellt werden. Jetzt könnt Ihr die gewünschten Stellen des Bildes einzeln markieren. Es gibt mehrere “Brushes”, die verwendet werden können, um z.B. Objekt A horizontal nach rechts und Objekt B in die genau andere Richtung horizontal links zu verschieben. Auch in vertikale Richtung ist dies möglich. Sind die Einstellungen getan, dann einfach unten rechts auf “Generate 4 s” klicken und ein Video aus dem Bild mit einer Länge von 4 Sekunden generieren. Dies ließe sich bei einem erfolgreichen Output dann auch über die Funktion “Extend” erweitern.

Im Output-Video ist direkt zu erkennen, dass sich die markierten Stellen korrekt bewegen. Das Video kann als MP4 heruntergeladen und auch als öffentlicher Link geteilt werden. Neben der Funktion “Motion Brush” kann auch das gesamte Bild mittels Textprompt animiert werden, in dem dann präzise Angaben per Prompt etwa zur Bewegung gemacht werden. Auch die Änderung der Kameraführung ist möglich, bis hin zu einer Vogelperspektive. Dies sind so einige sinnvolle Settings, die recht fix zu überblicken sind. Also vorab genau umschauen und dann kann es losgehen.

Fazit

Es gibt mittlerweile viele sinnvolle Möglichkeiten, Bilder ganz gezielt mit Funktionen wie dem “Motion Brush” zu animieren, auch in einem bestimmten Umfang kostenfrei. RundwayML ist dabei einer der Top-Anbieter. Auch bei Adobe oder Pika sind solche Animationen möglich. Unglaublich cool ist, dass die KI-Anwendung nach dem Markieren etwa des Surfbretts und “Robo-Sharks” automatisch erkennt, dass sich ebenfalls Wellen und auch die Haare der Surferin in die passende Richtung bewegen müssen.

Wieso nicht beim nächsten Mal ein Kräftegleichgewicht (Zeichnung) im Rahmen der Technischen Mechanik oder einen Tornadorüssel und ein Molekül (H2O…) animieren lassen? 😉

Hier geht’s zum Public Link (MP4)

Bilder / Video können gerne frei verwendet werden. Lizenz: DEED CC BY 4.0